Me especializo en la intersección entre Inteligencia Artificial, Data Engineering y Automatización, diseñando sistemas que transforman datos en decisiones y modelos en soluciones productivas.

Trabajo con arquitecturas modernas basadas en:

- Contenedores y microservicios

- Bases de datos vectoriales

- Pipelines escalables en la nube

- Integración de LLMs en entornos productivos

Estos son algunos de mis proyectos:

-

N8N con Base de Datos Vectorial y OpenAI

Este proyecto implementa un entorno n8n en Docker para automatizar flujos de trabajo de IA con OpenAI y Supabase como base de datos vectorial. Incluye: – Contenedor n8n con PostgreSQL como base de datos. – Workflows para traer datos desde una BD vectorial y agregar embeddings a una BD vectorial.

-

Pipeline de Datos SEO con Python, Google Search Console y Google Analytics

Implementación de un pipeline automatizado para monitoreo SEO y performance, centralizando datos históricos en BigQuery y habilitando dashboards confiables para equipos de Marketing y Producto.

-

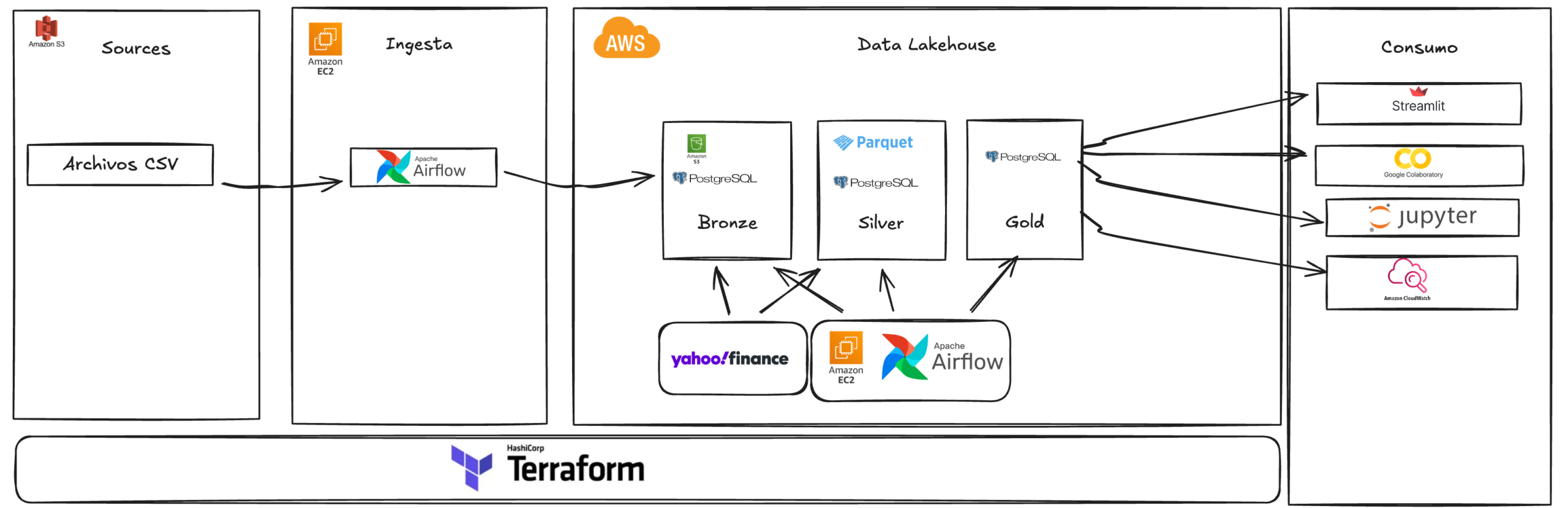

Pipeline de Datos en AWS con Airflow y dbt

Implementación de un data pipeline escalable con almacenamiento en AWS S3 y carga en PostgreSQL (RDS). Desarrollo de un flujo ETL end-to-end para la ingesta, transformación y almacenamiento de datos. Incluye integración de múltiples fuentes (CSV, JSON, API), procesamiento con dbt y orquestación con Airflow en contenedores Docker.

-

N8N con Base de Datos Vectorial y OpenAI

Este proyecto implementa un entorno n8n en Docker para automatizar flujos de trabajo de IA con OpenAI y Supabase como base de datos vectorial. Incluye: – Contenedor n8n con PostgreSQL como base de datos. – Workflows para traer datos desde una BD vectorial y agregar embeddings a una BD vectorial.

-

Pipeline de Datos SEO con Python, Google Search Console y Google Analytics

Implementación de un pipeline automatizado para monitoreo SEO y performance, centralizando datos históricos en BigQuery y habilitando dashboards confiables para equipos de Marketing y Producto.

-

Pipeline de Datos en AWS con Airflow y dbt

Implementación de un data pipeline escalable con almacenamiento en AWS S3 y carga en PostgreSQL (RDS). Desarrollo de un flujo ETL end-to-end para la ingesta, transformación y almacenamiento de datos. Incluye integración de múltiples fuentes (CSV, JSON, API), procesamiento con dbt y orquestación con Airflow en contenedores Docker.